دیپ لرنینگ (Deep Learning) یک روش یادگیری ماشین است که بر اساس شبکههای عصبی عمیق (Deep Neural Networks) اجرا میشود. این روش، بر پایه ساختار مشابه با ساختار شبکههای عصبی انسانی، قدرتمندترین روش یادگیری ماشین محسوب میشود.

شبکههای عصبی عمیق شامل لایههای بسیار زیادی از واحدهای محاسباتی است که به عنوان نورونها شناخته میشوند. این لایهها به صورت پشت سر هم قرار گرفته و با همدیگر ارتباط برقرار میکنند تا اطلاعات را از ورودی به خروجی منتقل کنند. هر لایه، ویژگیهای مختلف و به تدریج پیچیدهتر را از دادههای ورودی استخراج میکند و در نهایت به نتیجه خروجی میرسد.

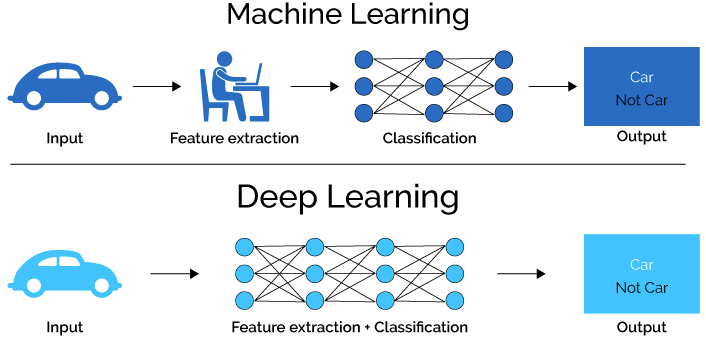

یکی از ویژگیهای برجسته دیپ لرنینگ، قابلیت یادگیری خودکار و تجزیهناپذیر برای استخراج ویژگیها است. به طور معمول، در روشهای یادگیری ماشین سنتی، نیاز به تعریف و انتخاب ویژگیهای دستی از دادههای ورودی وجود دارد. اما در دیپ لرنینگ، شبکههای عصبی عمیق قادر هستند ویژگیهای مهم را به صورت خودکار از دادههای ورودی استخراج کنند، بدون نیاز به تعریف دستی این ویژگیها. این امر باعث میشود که دیپ لرنینگ بتواند با دادههای بزرگ و پیچیده کار کند و نتایج بهتری در بسیاری از حوزههای مختلف از جمله بینایی ماشین، پردازش زبان طبیعی، تشخیص گفتار، ترجمه ماشینی و غیره، به دست آورد.

در نتیجه، دیپ لرنینگ به عنوان یکی از اصلیترین روشهای یادگیری ماشین امروزه، توانسته است در حوزههای مختلفی از مسایل پیچیده، پیشرفتهای قابل توجهی داشته باشد و به دلیل قدرت و انعطافپذیری خود، به عنوان یک ابزار مهم در علوم داده و هوش مصنوعی مورد استفاده قرار میگیرد.

از ماشین لرنینگ تا دیپ لرنینگ

مسیر تکامل از ماشین لرنینگ (Machine Learning) به دیپ لرنینگ (Deep Learning) را میتوان به صورت زیر خلاصه کرد:

ماشین لرنینگ یک روش یادگیری ماشین است که بر اساس الگوریتمها و مدلهای آماری اجرا میشود. در این روش، مدلهای آماری مانند رگرسیون خطی، ماشین بردار پشتیبان (SVM)، شبکههای عصبی ساده و غیره برای یادگیری الگوها و روابط در دادهها استفاده میشوند. معمولا در ماشین لرنینگ، ویژگیهای دستی از دادههای ورودی استخراج میشوند و سپس مدل بر اساس این ویژگیها آموزش داده میشود.

دیپ لرنینگ به معنی استفاده از شبکههای عصبی عمیق است. در این روش، شبکههای عصبی با ساختار چند لایه و بسیار پیچیده استفاده میشوند. این شبکهها از لایههای متعددی تشکیل شدهاند و هر لایه ویژگیهای مختلف و به تدریج پیچیدهتر را از دادههای ورودی استخراج میکند. در دیپ لرنینگ، شبکههای عصبی عمیق قادر به خودآموزش و استخراج خوکار ویژگیها هستند، بدون نیاز به تعریف دستی ویژگیها. این قابلیت باعث میشود که دیپ لرنینگ بتواند الگوها و ویژگیهای پیچیدهتر را در دادهها تشخیص دهد. به طور خلاصه، دیپ لرنینگ یک زیرمجموعه از ماشین لرنینگ است که بر اساس شبکههای عصبی عمیق عمل میکند. این روش به واسطه قابلیت استخراج خودکار ویژگیها و قدرتش در کار با دادههای پیچیده، در حوزههای گوناگونی استفاده میشود.

ماشین لرنینگ چیست؟

همانگونه که پیشتر اشاره کردیم، ماشین لرنینگ (Machine Learning) یک روش یادگیری ماشین است که به وسیله الگوریتمها و مدلهای آماری، ماشینها را قادر میسازد از دادهها یاد بگیرند و اطلاعات را بدون برنامهنویسی صریح بهبود دهند. در واقع، ماشین لرنینگ به ماشینها امکان میدهد از تجربههای گذشته خود بیاموزند و الگوها و روابطی را در دادهها تشخیص دهند.

در ماشین لرنینگ، معمولا دادهها به دو بخش تقسیم میشوند: دادههای آموزش و دادههای آزمایش. مدل ماشین لرنینگ با استفاده از دادههای آموزش، الگوها و قوانینی را کشف میکند و در نهایت بر اساس این الگوها، قادر است پیشبینیها و تصمیمگیریهایی را بر روی دادههای آزمایش انجام دهد. در ماشین لرنینگ، میتوان از مدلهای مختلفی استفاده کرد، از جمله:

- رگرسیون خطی: برای پیشبینی یک متغیر پیوسته بر اساس ورودیهای متغیرهای دیگر.

- ماشین بردار پشتیبان (SVM): برای تشخیص الگوها و دستهبندی دادهها به دستههای مختلف.

- شبکههای عصبی: ساختارهایی که مدلهایی از سیستم عصبی انسان را شبیهسازی میکنند و در بسیاری از مسایل پیچیده و قابل تعمیم مورد استفاده قرار میگیرند.

این روش، با توجه به قدرت خود در تشخیص الگوها و ارائه تصمیمات خودکار، به عنوان یکی از اصلیترین روشهای هوش مصنوعی شناخته میشود.

اهمیت مهندسی ویژگی

مهندسی ویژگی (Feature Engineering) در ماشین لرنینگ و دیپ لرنینگ اهمیت بسیاری دارد. ویژگیها، معمولا اطلاعات مهمی درباره دادهها را شامل میشوند و استخراج و انتخاب صحیح آنها میتواند تاثیر قابل ملاحظهای در عملکرد مدلها داشته باشد. از دلایل مهم بودن مهندسی ویژگی به موارد زیر باید اشاره کرد:

استخراج دقیق دادهها: با استفاده از مهندسی ویژگی، میتوانیم ویژگیهای مناسبی را از دادهها استخراج کنیم که نماینده خوبی برای تمامی اطلاعات موجود باشند. این ویژگیها میتوانند الگوها، روابط یا ویژگیهای مهم دادهها را بهبود بخشند و برای مدلها، اطلاعاتی کاربردی و قابل استفاده فراهم کنند.

افزایش دقت و عملکرد مدل: با انتخاب و استخراج ویژگیهای مناسب، میتوان دقت و عملکرد مدلها را بهبود بخشید. ویژگیهای خوب و معنادار میتوانند اطلاعات مهمتری را در دادهها نمایش دهند و مدل را در تصمیمگیری بهتر یاری کنند. همچنین، با کاهش ابعاد ویژگیها و حذف ویژگیهای بیاهمیت، میتوانیم مدل را سادهتر و قابل تحلیلتر کنیم.

پایداری در برابر دادههای ناهنجار: با استفاده از مهندسی ویژگی، میتوانیم ویژگیهایی را تعریف کنیم که مدل را در برابر دادههای ناهنجار و خطاهای رایج پایدارتر کنند. به عنوان مثال، استخراج ویژگیهای متحمل به تغییرات و نویز میتواند عملکرد مدل را در مواجهه با دادههای ناهنجار بهبود بخشد.

تفسیرپذیری مدل: استفاده از ویژگیهای قابل تفسیر و قابل فهم میتواند به محققان و کاربران امکان دهد تا درک بهتری درباره عملکرد مدل و دلایل تصمیمگیری آن داشته باشند. این امر در برخی حوزهها مانند پزشکی، حقوق و غیره اهمیت زیادی دارد.

بنابراین، مهندسی ویژگی به عنوان یک مرحله مهم در فرایند توسعه مدلهای ماشین لرنینگ، نقش بسیار مهمی ایفا میکند. انتخاب درست ویژگیها، استخراج و واکشی اطلاعات مهم از دادهها، کاهش ابعاد ویژگیها و ساخت ویژگیهای جدید، میتواند بهبود قابل توجهی در دقت و عملکرد مدلها ایجاد کند و درک ما از دادهها و رفتار مدلها را تسهیل کند.

اهمیت دیپ لرنینگ در چیست؟

دیپ لرنینگ (Deep Learning) به عنوان یک زیرمجموعه از ماشین لرنینگ، اهمیت بسیار زیادی در حوزه هوش مصنوعی و تکنولوژی دارد. این روش، بر اساس شبکههای عصبی عمیق و ساختارهای پیچیدهتر، قادر است الگوها و ویژگیهای پنهان و پیچیده را از دادهها استخراج کرده و با بهبود قابل توجهی در دقت و عملکرد، برخی از مسایل پیچیده را حل کند.

یکی از دلایل مهم بودن دیپ لرنینگ، قابلیتش در تشخیص و تفسیر الگوهای پیچیده است. با توجه به ساختار عمیق شبکههای عصبی، دیپ لرنینگ میتواند الگوهای پیچیدهتری را نسبت به مدلهای سطح بالاتر تشخیص دهد. این قابلیت به ویژه در حوزههایی مانند تشخیص تصویر، ترجمه ماشینی، پردازش زبان طبیعی و تحلیل دادههای ساختار گرافی بسیار اهمیت دارد.

همچنین، دیپ لرنینگ برای مسایلی که دادههای غیرساختاری و بزرگی را در بر میگیرند، بسیار مناسب است. معماریهای شبکههای عصبی عمیق، با قدرت پردازش بالا و توانایی یادگیری از دادههای بزرگ، میتوانند در تحلیل و پردازش دادههای تصویر، صوت، متن، ویدیو و دادههای سنسوری مورد استفاده قرار گیرند.

دیپ لرنینگ همچنین برای ارائه راهحلهای مبتنی بر هوش مصنوعی در حوزههایی مانند خودرانی، تشخیص بیماریهای پزشکی، تحلیل و پیشبینی بازارهای مالی، تحلیل اجتماعی و بسیاری از حوزههای دیگر بسیار اهمیت دارد. با توانایی یادگیری از دادههای طبیعی و تشخیص الگوهای پیچیده، دیپ لرنینگ میتواند بهبود قابل توجهی در عملکرد و دقت این سیستمها ایجاد کند. با وجود حجم بزرگ دادههای موجود امروزی، دیپ لرنینگ قادر است از این دادهها بهرهبرداری کند و الگوهای مخفی و پیچیدهتری را کشف کند. این قابلیت، امکان ارائه راهحلهای دقیقتر و موثرتر در مسایلی که قبلا دشوار بودند، را فراهم میکند.

مفاهیم اصلی دیپ لرنینگ

دیپ لرنینگ (Deep Learning) بر پایه مدلسازی ساختاری مغز انسان استوار است و تلاش میکند تا قدرت پردازش و تفسیر دادهها را بهبود بخشد. بنابراین، عملکردش شباهتهایی به عملکرد مغز انسان دارد. برخی از مفاهیم اصلی دیپ لرنینگ که باید در مورد آنها اطلاع داشته باشید را به صورت زیر میتوان خلاصه کرد:

شبکههای عصبی عمیق: در دیپ لرنینگ، از شبکههای عصبی عمیق استفاده میشود که شامل چندین لایه عصبی است. این شبکهها میتوانند ویژگیهای پنهان و پیچیده را از دادهها استخراج کنند و با تعداد بالای لایهها، امکان مدلسازی الگوهای پیچیدهتر و بهبود عملکرد را فراهم میکنند.

یادگیری عمیق: در دیپ لرنینگ، الگوریتمهای یادگیری عمیق مورد استفاده قرار میگیرند. این الگوریتمها با استفاده از دادههای آموزشی بزرگ، شبکههای عصبی را آموزش میدهند تا ویژگیهای مورد نظر را تشخیص دهند و الگوها را درک کنند. این یادگیری توسط شبکههای عصبی عمیق، به صورت خودکار و بدون نیاز به قواعد و دستورالعملهای صریح صورت میگیرد.

تابع فعالسازی: در دیپ لرنینگ، تابع فعالسازی (Activation Function) نقش مهمی در عملکرد شبکههای عصبی عمیق ایفا میکند. این تابع، ورودیهای شبکه را به صورت غیرخطی تبدیل میکند و به ایجاد غیرخطیت و توانایی مدل در تشخیص الگوهای پیچیده کمک میکند. توابع معمولی مورد استفاده در این روش شامل تابع سیگموید (Sigmoid)، تانژانت هیپربولیک (Tanh) و تابع ReLU (Rectified Linear Unit) هستند.

پیشآموزش: یکی از راهکارهای موثر در دیپ لرنینگ، استفاده از پیشآموزش است. در این روش، شبکه عصبی با استفاده از دادههای بزرگ و غیرمرتبط، مانند دادههای تصویری به طور مستقل آموزش میبیند.

شبکه های عصبی

شبکههای عصبی، ساختاری ریاضی هستند که بر اساس نحوه عملکرد سیستم عصبی انسان ساخته شدهاند. این شبکهها از یک مجموعه از واحدهای محاسباتی که نورونها نامیده میشوند، تشکیل شدهاند. هر نورون ورودیها را از طریق وزنهای متصل به خود دریافت کرده و یک تابع فعالسازی روی آن اعمال میکند. خروجی این نورون به نورونهای لایه بعدی منتقل میشود و این فرایند تا رسیدن به لایه خروجی ادامه مییابد.

شبکههای عصبی معمولا شامل سه لایه اصلی هستند: لایه ورودی، لایه مخفی و لایه خروجی. لایه ورودی وظیفه دریافت دادهها و انتقال آنها به لایه مخفی را دارد. لایه مخفی، ویژگیهای پنهان را از دادهها استخراج میکند و لایه خروجی، نتیجه نهایی را تولید میکند. هر لایه میتواند شامل چندین نورون باشد و هر نورون به تعدادی نورون در لایه قبلی وصل شده است.

برای آموزش شبکههای عصبی، از الگوریتمهای بهینهسازی مانند پسانتشار خطا (Backpropagation) استفاده میشود. در این الگوریتم، خطا بین خروجی مدل و خروجی مورد انتظار محاسبه شده و سپس به عقب در لایهها حرکت کرده و وزنها را به گونهای بهروزرسانی میکند که خطا کمینه شود. این فرایند آموزش تکرار میشود تا شبکه به صورت مطلوب عمل کند. شبکههای عصبی عمیق، شبکههایی هستند که بیش از یک لایه مخفی دارند. این لایههای اضافی به شبکه امکان میدهند تا ویژگیهای پیچیدهتری را از دادهها استخراج کند و عملکرد بهتری داشته باشد.

با استفاده از شبکههای عصبی، میتوان مسایل پیچیدهتری را حل کرد، مانند تشخیص تصاویر، ترجمه ماشینی، تشخیص گفتار و تحلیل دادههای بزرگ. این شبکهها به خاطر قدرتشان در تشخیص الگوها و یادگیری از دادهها، در زمینههای مختلف که شامل تشخیص تصاویر، ترجمه ماشینی، تشخیص گفتار و تحلیل دادههای بزرگ است مورد استفاده قرار میگیرند.

توابع فعال سازی

توابع فعالسازی (Activation Functions) در شبکههای عصبی عمیق برای انجام اعمال غیرخطی و تبدیل ورودیها به خروجیهای غیرخطی استفاده میشوند. این توابع نقش مهمی در قدرت مدل سازی و توانایی شبکههای عصبی دارند. در زیر، چند تابع فعالسازی رایج در دیپ لرنینگ آورده شده است:

تابع سیگموید (Sigmoid)، ورودی را به مقداری بین 0 و 1 تبدیل میکند که میتوان آن را به عنوان یک احتمال تفسیر کرد. تابع سیگموید معمولا در لایههای آخر شبکههای عصبی که نیاز به تولید خروجیهای محدود بین 0 و 1 دارند، استفاده میشود. تابع تانژانت هیپربولیک (Tanh) ورودی را به مقداری بین -1 و 1 تبدیل میکند. تابع تانژانت هیپربولیک نسبت به تابع سیگموید تعمیم یافتهتر است و دامنه بزرگتری را پوشش میدهد. از این تابع میتوان در لایههای مخفی شبکههای عصبی استفاده کرد. تابع ReLU (Rectified Linear Unit) ورودی را به صورت غیرخطی تبدیل میکند و همه مقادیر منفی را به صفر تبدیل میکند. تابع ReLU به دلیل سادگی محاسباتی و قدرت تشخیص الگوهای پراهمیت در شبکههای عصبی عمیق، بسیار محبوب است و به عنوان یکی از توابع فعالسازی پرکاربرد در لایههای مخفی استفاده میشود. این توابع فقط نمونهای از توابع فعالسازی موجود در دیپ لرنینگ هستند و هنوز مطالعات بسیاری در حال انجام است برای بهبود و ارتقای عملکرد شبکهها. در واقع، هر تابعی که غیرخطی و مشتقپذیر باشد، میتواند به عنوان تابع فعالسازی در شبکههای عصبی استفاده شود.

یادگیری عمیق یا دیپ لرنینگ چگونه کار می کند؟

یادگیری عمیق یا دیپ لرنینگ (Deep Learning) بر اساس شبکههای عصبی عمیق مبتنی بر لایهها عمل میکند. فرایند یادگیری عمیق در دیپ لرنینگ عموما شامل مراحل زیر است:

تعریف معماری شبکه عصبی: در ابتدا، معماری شبکه عصبی تعریف میشود. این شبکه شامل لایههای مختلفی از نورونها است که به صورت سلسله مراتبی در هم قرار دارند. عموما شبکههای عمیق شامل لایههای ورودی، لایههای مخفی و لایههای خروجی هستند.

آموزش شبکه: در این مرحله، شبکه عصبی با استفاده از دادههای آموزشی آموزش داده میشود. برای آموزش شبکه، ابتدا دادههای آموزشی به شبکه داده میشوند و خروجی مورد انتظار برای هر داده مشخص میشود. سپس از روشهای بهینهسازی مانند پسانتشار خطا (Backpropagation) استفاده میشود تا وزنهای شبکه به گونهای بهروزرسانی شوند که خطا کمینه شود.

آزمون و ارزیابی: پس از آموزش شبکه، آن را بر روی دادههای آزمون یا ورودیهای جدید ارزیابی میکنیم. شبکه به این صورت استفاده میشود که داده جدید به شبکه داده میشود و خروجی مورد انتظار محاسبه میشود. سپس میزان خطا و عملکرد شبکه ارزیابی میشود.

تنظیم و بهینهسازی: در صورتی که عملکرد شبکه نسبت به پیشبینیها و خطاها به اندازه کافی خوب نباشد، میتوان به منظور بهبود آن تغییراتی در معماری شبکه و یا پارامترهای شبکه اعمال کرد. این تنظیمات و بهینهسازیها میتوانند شامل تغییر تعداد لایهها، تعداد نورونها، تابع فعالسازی و سایر پارامترهای شبکه باشند.

فرایند یادگیری عمیق با استفاده از بزرگترین مزیت شبکههای عصبی، یعنی قابلیت مدل سازی و استخراج ویژگی های پیچیده، بهبود یافته است. با افزایش تعداد لایهها و نورونها، شبکه عصبی عمیق میتواند نمایشهای پیچیدهتری از دادهها را بیان کند و ویژگیهای غیرخطی را استخراج کند. این قابلیت به شبکههای عصبی عمیق اجازه میدهد تا در حل مسایلی که الگوها و وابستگیهای پیچیدهتری دارند، عملکرد بهتری نسبت به روشهای سنتی داشته باشند. به طور کلی، یادگیری عمیق با استفاده از شبکههای عصبی عمیق و تعداد زیادی لایه، نورون و پارامتر، قادر است الگوها و وابستگیهای پیچیده را در دادهها شناسایی و مدل کند.

هوش مصنوعی و دیپ لرنینگ

هوش مصنوعی (Artificial Intelligence) و دیپ لرنینگ (Deep Learning) دو مفهوم مرتبط با یکدیگر هستند. هوش مصنوعی به طور کلی به هر گونه هوش یا هوشمندی که توسط ماشینها و سیستمهای کامپیوتری شبیهسازی میشود، اشاره دارد. این حرف در عمل به معنای استفاده از الگوریتمها و روشهای کامپیوتری برای مدلسازی، تحلیل و تفسیر دادهها و انجام کارهای هوشمندانه است.

دیپ لرنینگ، به عنوان یکی از روشهایی که در زمینه هوش مصنوعی استفاده میشود، بر اساس شبکههای عصبی عمیق مبتنی بر لایهها عمل میکند. این روش تلاش میکند تا ساختار و عملکرد مغز انسان را شبیهسازی کند. با استفاده از لایههای مختلف از نورونها و الگوریتمهای بهینهسازی، دیپ لرنینگ قادر است الگوها و وابستگیهای پیچیده در دادهها را شناسایی و مدل کند.

به عنوان یکی از روشهای هوش مصنوعی، دیپ لرنینگ در بسیاری از حوزهها و برنامههای کاربردی استفاده میشود. برای مثال، در حوزه بینایی ماشین، دیپ لرنینگ قادر است تصاویر را تشخیص دهد، اشیا را دستهبندی کند و حتی توانایی تولید تصاویر جدید را داشته باشد. در حوزه پردازش زبان طبیعی، دیپ لرنینگ میتواند برای ترجمه ماشینی، تحلیل متن و پاسخ به سوالات استفاده شود. همچنین، در حوزه تشخیص گفتار، تشخیص تقلب مالی، پیشبینی بازارها و بسیاری از حوزههای دیگر، دیپ لرنینگ به طور گسترده مورد استفاده قرار میگیرد.

از آنجایی که دیپ لرنینگ توانایی مدل کردن الگوها و وابستگیهای پیچیده را دارد، این روش میتواند در بسیاری از مسایل پیچیده و چالشبرانگیز بازدهی بالایی داشته باشد. با این حال، دیپ لرنینگ نیاز به حجم بالایی از دادههای آموزشی دارد و همچنین ممکن است مشکلاتی مانند پیچیدگی محاسباتی و نیاز به واحدهای محاسباتی گرافیکی زیاد داشته باشد. همچنین، تنظیم و بهینهسازی شبکههای عصبی عمیق نیز ممکن است چالشهای خاصی را ایجاد کند.

موارد استفاده دیپ لرنینگ چیست؟

دیپ لرنینگ در بسیاری از حوزهها کاربرد دارد. در حوزه بینایی ماشین، از دیپ لرنینگ برای تشخیص و دستهبندی تصاویر، تشخیص چهره، تشخیص اشیا و تحلیل تصاویر پزشکی استفاده میشود. در حوزه پردازش زبان طبیعی، دیپ لرنینگ میتواند برای ترجمه ماشینی، تولید متن، تحلیل متن و پاسخ به سوالات استفاده شود. در حوزه صوت و گفتار، دیپ لرنینگ میتواند برای تشخیص گفتار، تولید گفتار و ترجمه گفتار به متن استفاده شود. همچنین، دیپ لرنینگ در حوزه خودرانها، تشخیص تقلب مالی، پیشبینی بازارها، پزشکی و بسیاری از حوزههای دیگر نیز کاربرد دارد. به طور کلی، دیپ لرنینگ به دلیل قدرتش در تشخیص الگوها و وابستگیهای پیچیده، در بسیاری از مسایل هوش مصنوعی مورد استفاده قرار میگیرد.

الگوریتم های محبوب دیپ لرنینگ چیست؟

در دیپ لرنینگ، از الگوریتمها و معماریهای مختلف استفاده میشوند، اما چند الگوریتم و معماری محبوب و پرکاربرد وجود دارند که در زمینه دیپ لرنینگ به طور گسترده استفاده میشوند. در زیر به برخی از این الگوریتمها اشاره میکنم:

شبکههای عصبی پیچشی (Convolutional Neural Networks – CNN): این الگوریتم برای پردازش تصاویر و تشخیص الگوها در تصاویر استفاده میشود. با استفاده از لایههای پیچشی و لایههای تجمیع، CNN قادر است ویژگیهای مهم تصویر را استخراج کند و به دستهبندی دقیق تصاویر بپردازد.

شبکههای عصبی بازگشتی (Recurrent Neural Networks – RNN): این الگوریتم برای پردازش دادههای دنبالهای مانند متن و گفتار استفاده میشود. با استفاده از مدلهای حافظه بلند کوتاهمدت LTSM سرنام LSTM (Long Short-Term Memory) یا GRU سرنام (Gated Recurrent Unit)، RNN قادر است به توجه به تاریخچه دادهها و مدلکردن وابستگیهای طولانی در دادههای دنبالهای بپردازد.

شبکههای مولد تخاصمی (Generative Adversarial Networks – GAN): این الگوریتم برای تولید دادههای جدید بر اساس توزیع دادههای آموزشی استفاده میشود. با استفاده از دو شبکه عصبی متضاد، یک شبکه مولد و یک شبکه تمییزدهنده (Discriminator)، شبکه مولد تخاصمی قادر است دادههای جدیدی تولید کند که به طور ظاهری شبیه به دادههای آموزشی باشند.

شبکههای خودرمزگذار-رمزگشای (Autoencoder Networks): این الگوریتم برای کاهش ابعاد دادهها، استخراج ویژگی و تولید دادههای جدید استفاده میشود. با استفاده از لایههای خودرمزگذار و رمزگشای، این شبکهها قادرند دادهها را به فضای نهان کاهش دهند و سپس با استفاده از رمزگشای، دادههای اولیه را بازسازی کنند.

این الگوریتمها تنها چند نمونه از الگوریتمهای محبوب در دیپ لرنینگ هستند و در عمل، بسیاری از معماریها و الگوریتمهای مختلف بر اساس نیازهای و مسایل خاص مورد استفاده قرار میگیرند. همچنین، معماریهای ترکیبی نیز وجود دارند که از ترکیب این الگوریتمها و لایههای مختلف برای حل مسایل پیچیدهتر استفاده میکنند.

بدون دیدگاه